Sok posztban foglalkoztunk már azzal, hogy a gépi tanulás és mesterséges intelligencia kétélű fegyver: használják mind a védelem oldalán, és persze a támadók is élnek vele.

Két idézet is jól rávilágít, mennyire aktuális lett ennek a területnek a felhasználása. Az egyik szerint: "A mesterséges intelligencia megjelenése miatt a technológiai fejlődés és a társadalmi változások annyira felgyorsulnak, amit a szingularitás előtt élők képtelenek felfogni vagy megbízhatóan kezelni.". A másik mondás pedig a McKinsey Global Institute kutatóitól származik: "100 év alatt húszezer évnyi fejlődést hozhat a mesterséges intelligencia".

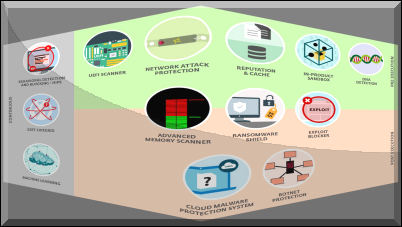

A vírusvédelemben is sokan aktívan alkalmazzák a kezdetektől. Például az Esetnél már 1989-től adatgyűjtés-osztályozás, 1995-től pedig gépi tanulás, és több integrált belső modul is kihasználja, például a Live Grid, Exploit Blocker, Botnet Protection, Antiransomware, stb.

De nem csak a védelemnél dolgozik az AI, hanem a víruslaborokban is régóta működik a kézi elemzés mellett automata feldolgozás, például az ESET LiveGuard Advanced (Dynamic Threat Defense) is használja a sandbox technológiát és a gépi tanulást.

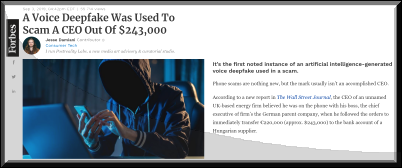

Ám a támadói oldal is gőzerővel fejlődik, ehhez beidézhetjük például azt a korábbi esetet, ahol 2019-ben a DeepVoice hangszintetizálás segítségével a RealTalk programmal a támadók a németországi igazgató hangján és nevében felhívták a brit energetikai cég vezetőjét, és megtévesztve 220 ezer eurós (akkori áron cirka 72m HUF) azonnali átutalást kértek egy magyar beszállító partner számlájára.

Mire kiderült a csalás, a pénzt már továbbutalták, és a cégnél csak későn vették észre a trükköt.

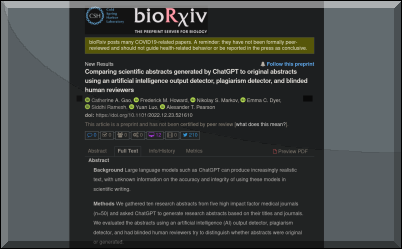

Most több cikk is foglalkozik azzal, hogy a Photoshop-Deepfake-Fakenews tengely után újabb nehezen felismerhető megtévesztések érkeznek, és ezek mind AI alapú fejlesztések eredménye. Kezdhetjük azzal, hogy egy Northwestern University által vezetett kutatócsoport olyan kísérletet végzett, amely a ChatGPT által generált hamis tudományos értekezések hihetőségét próbálta vizsgálni és tesztelni. Legeneráltak az OpenAI által fejlesztett eszközzel 50 darab publikációt öt különböző orvosi folyóirat stílusában.

Felvettek négy akadémikust, és pénzfeldobással eldöntve véletlenszerűen kaptak bírálatra hamis vagy valódi értekezést. A végeredmény rámutatott, hogy az AI anyagok 32%-át valódinak ítélték, míg a valódi anyagok közül 14%-ot gondoltak hamisnak - vagyis ez a fajta manipuláció nagyon eredményes lehet.

Ha most a valódi kibertámadásokat vesszük, ebben is látunk vészjósló felhőket: miszerint az AI által generált adathalász e-mailek sokkal meggyőzőbbek, tehát veszélyesebbek lettek. A GPT-3 modul mind a testre szabott, célzott phishing levelek finomhangolásában, mind a hihető álhírek generálásában jeleskedett. Emiatt jól látható, hogy az átverés áldozatai számára még nehezebb lesz azonosítani az AI által írt rosszindulatú és hamis tartalmakat.

Persze AI mentesen is lehet jól célozni csalásokat, ha például feltörik a céges levelezést (BEC, Business E-mail Compromise) és abban megfigyelik a hierarchiát, a szervezet működését, úgy a külsős és belsős kulcsemberek nevében tudnak olyan megtévesztő üzenetet írni, ahogy például a Magyar Vízilabda-szövetség berkein belül 120 ezer eurót (kb. 50 mHUF) egy állítólagos "új" számlára kértek utalni a bűnözők.

És a hogy a végére is maradjon még érdekesség, a Microsoft kutatói egy olyan szövegfelolvasó (Text To Speech, TTS) modellen dolgoznak, amely mindössze három másodperces mintával történő betanítás után képes utánozni egy adott személy hangját, és nem is akárhogyan: érzelmekkel és megfelelő intonációval kiegészítve.

Vagyis már jó ideje nem hihetünk a szemünknek az 1988-ban megjelent 34 éves Photoshop program miatt a képeknek, aztán 2018. óta a Deepfake már a videós tartalmak megbízhatóságát is kérdőjelessé tette, közben mindenütt hegyekben áll a fakenews és lassan az ismerősünk hangja sem lesz már garancia arra, hogy valóban ő maga kér-e tőlünk valamit, vagy egy ismeretlenek által használt VALL-E program. Jól fel van tehát adva a lecke mindenkinek a csalások, átverések felismerése területén, készülhetünk.

Head Honcho 2023.01.12. 18:41:35

Csizmazia Darab István [Rambo] · http://antivirus.blog.hu 2023.01.12. 18:50:01

Head Honcho 2023.01.14. 08:46:16